Proteção à saúde no meio ambiente digital: o princípio da precaução e as neurotecnologias

Protection to health on digital environment: the precautionary principle and neurotechnologies

Aurea Maria de Carvalho1; Ricardo Libel Waldman2

DOI: https://doi.org/10.37767/2591-3476(2024)13

Fecha de envío: 30.06.2024

Fecha de aceptación: 20.08.2024

RESUMO:

Esse artigo reflete sobre o avanço das tecnologias da informação e da comunicação (TIC), especialmente a neurotecnologia, a tecnologia aplicada ao ramo da Medicina chamado Neurologia, seus benefícios e a incerteza dos riscos que podem advir de sua implementação. Assim, são abordadas a necessidade de observância da ética e da dignidade da pessoa humana, como pressupostos de condutas médicas, além do respeito aos dados neuronais obtidos. Em se tratando de TIC, aborda-se a proteção do meio ambiente digital no Brasil como elemento da proteção ambiental na Constituição Federal brasileira. Conclui que nesse contexto, o princípio da precaução é relevante, já que não há certeza do impacto causado pela neurotecnologia podendo eles gerarem danos importantes a diretos fundamentais: exemplo é o caso da Neuralink, que comprovou ter procedido a implante de microchip neuronal em paciente humano. O método de aproximação é o hipotético dedutivo e a pesquisa é de natureza bibliográfica.

RESUMEN: En este artículo se reflexiona sobre el avance de las tecnologías de la información y la comunicación, especialmente la neurotecnología, la tecnología aplicada a la rama de la Medicina denominada Neurología, sus beneficios y la incertidumbre de los riesgos que pueden derivarse de su aplicación. Así, se aborda la necesidad de observar la ética y la dignidad humana, como presupuestos de la conducta médica, además del respeto a los datos neuronales obtenidos. En lo que respecta a las tecnologías de la información y la comunicación, la protección del entorno digital en Brasil se considera un elemento de protección del medio ambiente en la Constitución Federal brasileña. Concluye que el principio de precaución es relevante en este contexto, considerando que no hay certeza sobre el impacto causado por la neurotecnología y pueden causar daños importantes a los derechos fundamentales: por ejemplo, este es el caso de Neuralink, que demostró haber implantado un microchip neuronal en un paciente humano. El método de aproximación es hipotético-deductivo y la investigación es de carácter bibliográfico.

ABSTRACT

This article reflects on the advancement of information and communication technologies, especially neurotechnology, the technology applied to the branch of Medicine called Neurology, its benefits and the uncertainty of the risks that may arise from its implementation. So, the need to observe ethics and human dignity are addressed, as presuppositions for medical conduct, in addition to respect for the neuronal data obtained. When it comes to information and communication technologies, the protection of the digital environment in Brazil is considered as an element of environmental protection in the Brazilian Federal Constitution. It concludes that precautionary principle is relevant in this context, considering that there is no certainty about the impact caused by neurotechnology and they may cause important damages to fundamental righs: for example, this is the case of Neuralink, which proved to have implanted a neuronal microchip in a human patient. The approximation method is hypothetical-deductive and the research is of a bibliographic nature.

PALAVRAS-CHAVE: neurotecnologia, ética, meio ambiente digital, dignidade da pessoa humana, princípio da precaução.

PALABRAS CLAVE: neurotecnología, ética, entorno digital, dignidad humana, principio de precaución.

KEY WORDS: neurotechnology, ethics, digital environment, human dignity, precautionary principle.

Introdução

O presente estudo chama a atenção para o avanço das tecnologias da informação e da comunicação (TIC), notadamente a inteligência artificial (IA) na área da neurologia. O primeiro tópico aborda os benefícios que a IA pode trazer, como a inclusão social e econômica do indivíduo com deficiência, a superação das dificuldades. Em contrapartida também atenta para o risco de lesão aos direitos do ser humano, introduzindo a análise do tópico seguinte. A partir dessas constatações, por meio do método hipotético-dedutivo analisa a hipótese de uma regulamentação desta tecnologia com base no princípio da precaução. A pesquisa é de natureza bibliográfica.

Nesse sentido, a seção a seguir assevera a importância da observância da ética e do respeito a dignidade humana no uso da neurotecnologia, destacando a necessária preservação da igualdade no tratamento dos indivíduos.

Na sequência, o estudo mostra que a Organização Mundial da Saúde (OMS) está atenta ao avanço tecnológico e sua ingerência na medicina. Ver-se-á que inquietação da OMS culmina na implementação de princípios norteadores das atividades ligadas à neurotecnologia, de forma a preservar a saúde e integridade humana.

Na seção seguinte, discute-se a aplicabilidade do princípio da precaução para a inteligência artificial no direito brasileiro, a partir do conceito de meio ambiente digital, o qual implica, de acordo com a Constituição Federal (CF), na incidência dos princípios do direito ambiental para as novas TIC.

O tópico cinco apresenta uma análise sobre a incidência do princípio da precaução, emergido a partir do artigo 225 da CF de 1988, diante da incerteza do impacto a ser causado pelas neurotecnologias.

Na sequência, é feita uma breve análise do caso da empresa Neuralink e seus objetivos de pesquisa cientifica, com apontamento da experiência de implante de chip neuronal em paciente humano, bem como, as práticas existentes com experimentos em animais.

I. A IA no campo Neurológico

O uso da IA para auxílio no tratamento de pessoas com deficiências cognitivas, de linguagem e comprometimento motor, teve lugar de discussão em 1956. A partir de então, a exploração do tema, do ponto de visa ético, foi ganhando maior alcance, especialmente, no tocante à autodeterminação do indivíduo e sua integridade psíquica (MELO, 2024, pp. 69-80).

Na realidade atual, com a evolução constante da IA aplicada no setor da saúde, os principais beneficiários do avanço tecnológico são aquelas pessoas com algum grau de deficiência física e doenças neurodegenerativas, através da utilização de programas potentes que viabilizem sua capacidade cognitiva, permitindo sua interação social, e desenvolvimento de aprendizagem com participação ativa (BELLONI, 2024).

A história tem demonstrado que a utilização de softwares educacionais e de mídias eletrônicas tem propiciado verdadeira inovação na área educacional, permitindo a inclusão através do ensino, e a geração de oportunidades no mercado de trabalho, de pessoas com deficiência (WARSCHAUER, 2005).

Justamente pelo seu caráter inovador, a neurotecnologia, tecnologia aplicada ao estudo neurológico, tem despertado o interesse de investidores interessados nos resultados advindos de sua utilização, após a divulgação de resultados que comprovam ser possível o desenvolvimento de aparelhos capazes de conectar a mente humana a computadores. Por um lado, para a medicina, essa interface cérebro-máquina oferece uma oportunidade de as pessoas com lesões neurodegenerativas serem inseridas na sociedade, através da supressão de suas dificuldades e limitações, mediante a potencialização do desenvolvimento de habilidades cognitivas (FIANI, REARDON, AYRES, CLINE e SITTO, 2021: e14192).

Às pessoas com lesões na medula espinhal, distúrbios neurodegenerativos e deficiências neurobiológicas, tem sido viabilizado o desenvolvimento de diversas habilidades mediante a conexão com dispositivos avançados de IA, projetados para serem conectados ao seu cérebro e ligados a computadores, de forma a lhes propiciar o controle aos movimentos de seu corpo, além de contribuir para elidir crises em quadros epilépticos (MELO, 2024, pp. 69-80).

Nesse sentido, vale citar que a brain-computer interface, ou interface cérebro computador, que se perfaz em uma comunicação entre o cérebro e as máquinas (VAUGHAN, 2003, pp. 94-109) trouxe muitos investimentos em neurotecnologia, através de exames do movimento dos olhos de usuários de computadores, tablets, óculos de realidade aumentada, smartphones e smartwatch, e robôs domésticos que atendem a um comando de voz do usuário. Também há uma interação mais invasiva através de implante de microchip intracraniano, se configurando com a incorporação do dispositivo ao tecido vivo, de forma a viabilizar a superação de limitações causadas por deficiências neurodegenerativas e neurológicas, e fomentação do desenvolvimento de habilidades de pessoas com transtornos sensoriais e cognitivos (POMPERMAYER, VILAÇA e DIAS, 2021: 57-87).

Efetivamente, a evolução tecnológica permite a inclusão social e econômica do indivíduo com deficiência, e viabiliza uma vida de acordo com sua dignidade como ser humano, dotando-o de autonomia e independência. Radabaugh (1993) entende que “Para as pessoas sem deficiência, a tecnologia torna as coisas mais fáceis, para as pessoas com deficiência a tecnologia torna as coisas possíveis”.

Conforme um estudo efetuado pelo Fundo das Nações Unidas para a Infância – UNICEF (2021), realizado em 2021, aproximadamente 240 milhões de crianças tem algum tipo de deficiência. Em meio a esse quadro alarmante, a neurotecnologia pode oferecer a dignidade para essas crianças, e fomentar sua na sociedade, através, elidindo as barreiras existentes no acesso à educação da eliminação de qualquer barreira ao acesso à educação.

A neurociência, através do uso da tecnologia como instrumento, pode implantar chips e etiquetas inteligentes no cérebro humano, para rastreá-lo e mapeá-lo, identificando e influenciando hábitos, alterando a percepção humana e sua psiquê, dando um novo contorno à sua autonomia. Nesse sentido, o cérebro humano passa a ser controlável e subordinado a uma manipulação externa, passível de aferição econômica por empresas de tecnologia, sendo considerado verdadeiro ativo financeiro (RODOTÀ, 2008).

Vale atentar ao fato de que, segundo Lee, na década de 1950, os primeiros entusiastas da IA ambicionaram a recriação da inteligência humana em uma máquina. Desde então a história mostrou à humanidade os avanços da tecnologia, permitindo tratamentos invasivos com a estimulação cerebral em pacientes com a doença de Parkinson, utilizando implante de eletrodos em áreas especificas do cérebro, viabilizando impulsos elétricos de alta frequência (LEE, 2019: 19).

Além disso, a evolução da IA tem permitido o desenvolvimento das neurotecnologias, a tecnologia aplicada ao estudo neurológico, notadamente na área da medicina, registrando atividades neuronais de forma precisa e permitindo diagnósticos específicos e de maneira precoce, através do registro e processamento de imagens (WALTZ, 2019: 978-987).

Preocupada com esses traços ambiciosos das empresas de tecnologia, e a possibilidade de controle da mente humana por máquinas, a Organização das Nações Unidas (2024), por meio do Alto Comissariado dos Direitos Humanos, pediu que fosse dada especial atenção ao tema, especialmente quanto a utilização de aplicativos inteligentes em desacordo com as normas internacionais de proteção aos direitos humanos. Isso porque apesar dos avanços tecnológicos que as novas tecnologias podem trazer para a ciência, por outro lado é necessário primar pelo respeito aos direitos humanos, e ao arcabouço legal protetivo à privacidade do ser humano, estabelecido nacional e internacionalmente.

Conforme Melo (2024: 69-80), à medida que a evolução tecnológica acontece, aumenta o risco de lesão ao direito de privacidade e ao direito de proteção de dados das pessoas, devendo, pois, ser maior a atenção do Estado a essa questão, quanto a edição de normas regulamentadoras e protetivas à ascensão da atuação algorítmica, uma vez que os dados neurais do ser humano não podem ser comercializados. Os direitos fundamentais devem ser respeitados, dentre eles a personalidade, a privacidade e a proteção de dados pessoais.

Partindo dessa questão, a seguir o estudo abordará a necessidade de observância da ética e do respeito à dignidade da pessoa humana, no uso de tecnologias inovadoras para melhoria da saúde das pessoas.

Perez Luño (2003) leciona sobre o reconhecimento pela doutrina, acerca do direito à privacidade dos dados neurais, como sendo um direito fundamental de status positivo, por se consubstanciar em dever estatal. Assim, a criação e implantação de políticas públicas que viabilizem o arcabouço protetivo dos dados neurais, deve ser garantida pelo Estado, com a edição de lei específica.

Atualmente, a sociedade mundial vive em meio às mudanças trazidas pelas novas TIC. A geração, o processamento e a distribuição da informação são as atividades centrais do desenvolvimento econômico e social. (CASTELLS, 2005 p. 51, nota 30) Nesse sentido, Castells (2003) assente que: “a história da criação e do desenvolvimento da Internet é a história de uma aventura humana extraordinária. Ela põe em relevo a capacidade que têm as pessoas de transcender metas institucionais, superar barreiras burocráticas e subverter valores estabelecidos no processo de inaugurar um mundo novo.”

Em razão disso, é necessário fiscalizar o uso e tratamento responsável da tecnologia da informação, de forma a minimizar eventuais efeitos danosos advindos de seu uso indiscriminado e indevido, notadamente, os danos provenientes de utilização indevida de dados neurais do ser humano, e práticas discriminatórias advindas do conhecimento de tais dados. O tema é de tamanha relevância que o Governo Americano em 2013 considerou por bem aprovar um projeto – BRAIN (Brain Research through Advancing Innovative Neurotechnologies) – visando o mapeamento de atividade neurológica para auxiliar na cura de deficiências neuronais (MELO, 2024: 69-80).

Bariffi (2024) destaca que a Europa também tem se preocupado com uso de dados neuronais, e em 2014 reuniu-se o conselho desse continente, para uma conferência internacional, com o objetivo de debater sobre o avanço tecnológico e os direitos humanos. Considerando o impacto causado ela tecnologia, e a necessidade de criação de uma estrutura interdisciplinar e ética.

O autor supracitado também traz, além desses dois pontos mencionados, a transparência e a responsabilidade como princípios informadores da ética e da guarida protetiva dos dados neuronais utilizados. O autor destaca o princípio da prevenção.

Barcarollo (2021) destaca o despreparo dos cientistas na aplicação da IA como instrumento de mapeamento do cérebro humano e eliminação ou minimização de limitações, representando, isto sim, verdadeiro risco de manipulação indevida, a ser regulado pelo Estado.

O tema é de tamanha relevância que a Organização Mundial da Saúde está atenta aos possíveis impactos causados na Medicina, pelo uso das tecnologias avançadas, e experimentos científicos, objeto de nosso próximo tópico.

II. A Preocupação da OMS

A OMS (2024) demonstrou preocupação com os contornos que podem ser assumidos da exploração neuronal pela IA nas mãos da comunidade científica e empresas investidoras, e emitiu uma orientação sobre Ética e Governação da IA para a Saúde, através de um levantamento de dados. Foi formulado um relatório que identificou quais os desafios éticos ligados ao uso indevido das tecnologias na saúde, e seis princípios éticos foram formulados para implementação a toda a comunidade internacional. Esses princípios servem como orientadores para o uso da tecnologia e garantem a proteção, em razão do impacto que pode ser sofrido pelas pessoas, em consequência aos desafios e riscos éticos associados à utilização da IA na saúde. Nos termos do relatório, a ética e os direitos das pessoas sobre seus corpos devem ser priorizados.

Os princípios divulgados pela OMS (2024) no relatório alhures mencionado são seis, e se consubstanciam no fundamento para a governança e regulamentação: proteção da autonomia da pessoa humana, permanecendo o indivíduo livre para tomar suas decisões médicas, sendo que sua privacidade deve ser protegida; a promoção do bem-estar e a segurança humana e o interesse público, devendo ser atendidos os requisitos para a segurança no uso da IA, e que sua indicação seja muito bem definida, com a disponibilidade de medidas de controle da qualidade e sua melhoria; transparência, explicabilidade e inteligibilidade, no sentido de que toda tecnologia aplicada seja documentada, desde o projeto até sua implantação, e que a documentação seja disponibilizada para debates e consulta pública; promoção da responsabilidade e prestação de contas, sendo necessário seu uso por pessoas habilitadas e capacitadas, ao mesmo tempo que garante sua responsabilização pelo mau uso da tecnologia. Tais princípios devem nortear o trabalho da OMS, que objetiva utilizar todo o potencial da IA, em benefício de todos.

O relatório preconiza ainda a garantia da inclusão e equidade, como forma de tratamento igualitário a todos os seres humanos, e acesso a tecnologia na saúde a todos, sem qualquer tratamento discriminatório; além de buscar a promoção responsiva e sustentável no uso da IA, de forma a minimizar consequências ambientais e aumentar a eficiência energética, sendo esse o compromisso a ser assumido por governos e empresas, aliado a capacitação dos profissionais de saúde.

Inobstante, é imprevisível a forma como a interface entre o homem e a IA irá se desenvolver no futuro, em que pese, ser imperioso o planejamento de medidas regulatórias que sirvam como freios ético-jurídicos hábeis a garantir a proteção dos direitos da personalidade e autodeterminação dos indivíduos (RUSSELL, 2019: xi).

Nota-se que o tratamento dos dados neurais carece de proteção efetiva, sendo essa uma das principais questões do século XXI, sendo necessário que uso das tecnologias no corpo humano se constitua em aliada para a melhoria e benefícios da saúde, e não acarrete um retrocesso na proteção da pessoa humana em todas as suas acepções (HARARI, 2016).

Para se ter uma ideia da importância do debate, a Universidade de Stanford (2023), nos Estados Unidos, publicou em abril de 2023 uma edição do relatório “Artificial intelligence index Report 2023”, constituído por uma análise feita anualmente sobre as tendências e impactos da IA. Dentre outras questões, o estudo apontou que a quantidade de incidentes causados pelo uso indevido da IA tem aumentado exponencialmente.

O banco de dados do “Algorithmic and Automation Incidents and Controversies” – AIAAIC (2024) efetua o rastreamento dos incidentes mencionados, e indica que essas ocorrências aumentaram 26 vezes desde 2012. Importante ressaltar que os dados do “AIAAIC Repository of AI, algorithmic, and automation incidentes and controversies” são públicos e sua apuração é feita de forma independente.

Diante dos evidentes riscos que podem surgir do mau uso ou uso indiscriminado da IA, notadamente à saúde, objeto do presente estudo, cumpre trazer à baila o princípio da precaução e o dever de cuidado, que devem ser observados.

A IA tem se mostrado importante aliada na medicina, permitindo a realização de procedimentos menos invasivos, minimizando o tempo de recuperação e auxiliando na detecção de patologias. Mas, seu uso deve ser criterioso, uma vez que seus impactos na sociedade ainda são desconhecidos.

Nesse sentido, é necessária uma proteção efetiva contra os danos que podem ser causados, sendo imperioso falar sobre a incidência do princípio da precaução nas atividades relacionadas a IA.

III. Da aplicabilidade do princípio da precaução à IA no Brasil

Conforme Vigliar, Waldman e Lima, (2023, p.165-166):

A conformação da vida na sociedade atual inclui a existência de um ambiente digital, o ciberespaço. O direito brasileiro protege este ciberespaço enquanto meio ambiente cultural, nos termos do artigo 216, II, da CF, embora não mencione a palavra “ciberespaço” como se descreverá a seguir.

O meio ambiente é uno, ainda que possa ser dividido em meio ambiente natural, cultural, artificial e do trabalho, sendo tais divisões meramente didáticas, de modo que o ciberespaço é, de acordo com o artigo 225 da Constituição brasileira um bem de uso comum do povo, isto é, os bens que os compõe são bens ambientais. Nesse sentido, os dados pessoais são bens ambientais, portanto sujeitos a um regime adequado a esta natureza e a proteção deste regime é um direito difuso na sociedade. Portanto, a proteção de dados pessoais para além de um direito individual de seus titulares, é um direito de titularidade difusa, permeando toda a sociedade.

Assim, o ciberespaço pode ser entendido como o conjunto de relações, equipamentos, dados (pessoais e outros), pessoas e software (incluindo big data, internet das coisas, IA e outros algoritmos), que se encontram por meio da rede mundial de computadores (LEVY, 2008 e LEVY, 2010).

Já há 20 anos, mas com um incremento importante após a pandemia do COVID-19, em 2020 e 2021, as pessoas vivem partes importantes de sua vida no ambiente do ciberespaço. De acordo com TIC domicílios 2023, 84% dos domicílios brasileiros tem acesso à internet. Mesmo nas classes D e E, a percentagem é de 67%. São 156 milhões de usuários de Internet. (CETIC, 2023). No âmbito internacional, o número de usuários de Internet cresceu 1,8% (97 milhões) nos últimos 12 meses, totalizando o total global de 5,35 bilhões de usuários, em um total de 8,08 bilhões de habitantes no planeta (KEMP, 2024, s.d.).

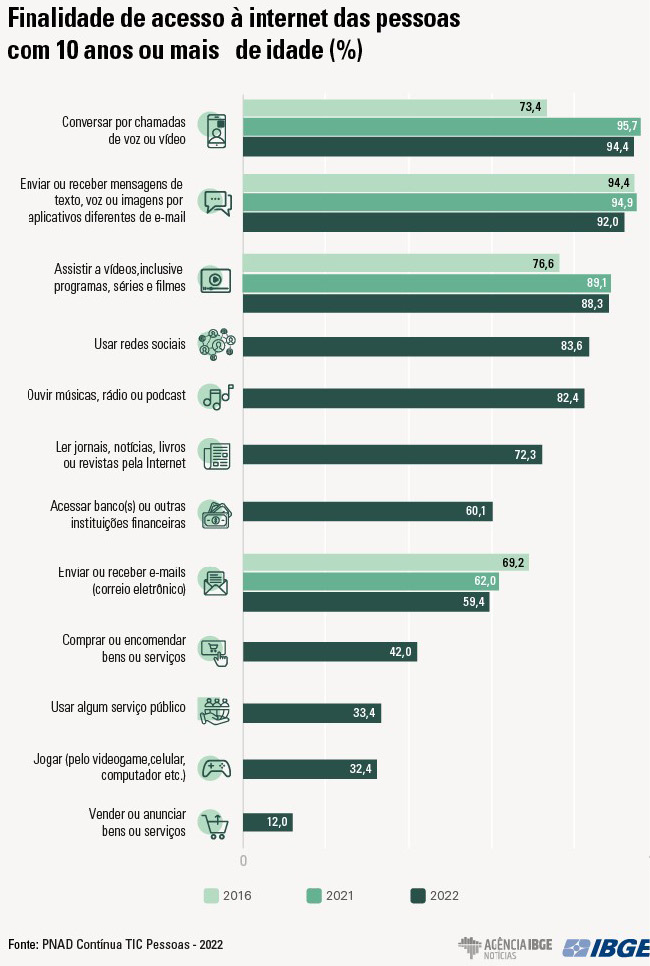

Voltando ao Brasil, a seguinte figura, ilustra a variedade de usos da Internet pelos brasileiros, em 2022, acima de 10 anos:

De acordo com Nery (2023, n.p.), pesquisa do IBGE identificou que 14,3% dos 68,9 milhões dos domicílios com Internet utilizavam dispositivos de internet das coisas, como ar-condicionado e geladeiras.

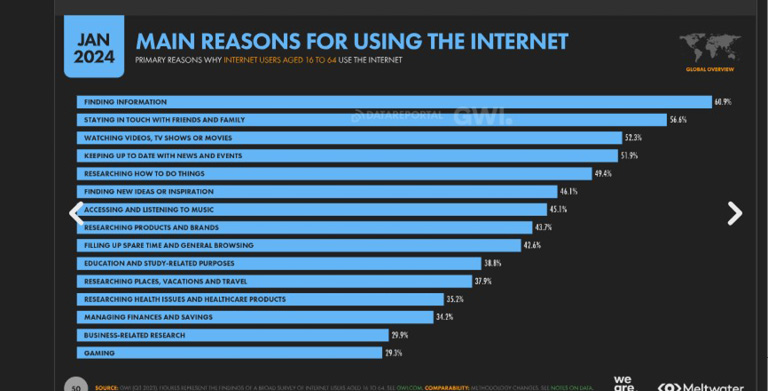

No plano internacional, temos a seguinte distribuição dos usos (KEMP, 2024):

Estes dados demonstram, com clareza, o fato de que o modo de vida atual, considerando relacionamentos pessoais, estudo, pesquisa, trabalho, transações financeiras e comerciais, é uma vida, em grande parte, no ciberespaço.

Agora, quando examinamos o art. 216 de Constituição da República Federativa do Brasil (CF), temos o seguinte:

“Art. 216. Constituem patrimônio cultural brasileiro os bens de natureza material e imaterial, tomados individualmente ou em conjunto, portadores de referência à identidade, à ação, à memória dos diferentes grupos formadores da sociedade brasileira, nos quais se incluem:

(...)

II - os modos de criar, fazer e viver;

(...)”

O patrimônio cultural é objeto de proteção do meio ambiente cultural (FIORILLO, 2015, loc. 2054-2080). Pois bem, o ciberespaço abrange formas de criar, fazer e viver da população brasileira, e, assim, é um aspecto do patrimônio cultural ou meio ambiente cultural. Este por sua vez é um aspecto do meio ambiente enquanto bem de uso comum no povo no contexto do art. 225 da CF (FIORILLO, 2015, loc. 2763):

“Art. 225. Todos têm direito ao meio ambiente ecologicamente equilibrado, bem de uso comum do povo e essencial à sadia qualidade de vida, impondo-se ao Poder Público e à coletividade o dever de defendê-lo e preservá-lo para as presentes e futuras gerações”.

Nesse sentido, as regras e princípios decorrentes deste dispositivo, aplicam-se também ao meio ambiente cultural, como reconhece relevante decisão do Supremo Tribunal Federal:

“A incolumidade do meio ambiente não pode ser comprometida por interesses empresariais nem ficar dependente de motivações de índole meramente econômica, ainda mais se se tiver presente que a atividade econômica, considerada a disciplina constitucional que a rege, está subordinada, dentre outros princípios gerais, àquele que privilegia a "defesa do meio ambiente" (CF, art. 170, VI), que traduz conceito amplo e abrangente das noções de meio ambiente natural, de meio ambiente cultural, de meio ambiente artificial (espaço urbano) e de meio ambiente laboral. Doutrina. Os instrumentos jurídicos de caráter legal e de natureza constitucional objetivam viabilizar a tutela efetiva do meio ambiente, para que não se alterem as propriedades e os atributos que lhe são inerentes, o que provocaria inaceitável comprometimento da saúde, segurança, cultura, trabalho e bem-estar da população, além de causar graves danos ecológicos ao patrimônio ambiental, considerado este em seu aspecto físico ou natural.” (ADI 3540 MC, Relator(a): CELSO DE MELLO, Tribunal Pleno, julgado em 01-09-2005, DJ 03-02-2006 PP-00014 EMENT VOL-02219-03 PP-00528)

Assim, entende-se que a distinção entre meio ambiente natural, artificial, cultural e do trabalho é meramente didática (TRENNEPOHL, 2024: 16-19 e 21) eis que o meio ambiente é uno. Trata-se de um conceito amplo de meio ambiente, adotado pela doutrina e jurisprudência brasileiras (SARLET; FENSTERSEIFER, 2023: 167). Meio ambiente, portanto, é bem uno, diferente dos elementos que o compõe, dos rios, dos mares, das áreas de preservação permanente ou do patrimônio cultural (BENJAMIN, 1993: 74-76).

Decorrência lógica do desenvolvido até o momento é que os princípios de direito ambiental se aplicam ao meio ambiente cultural e, portanto, ao meio ambiente digital, ou ciberespaço.

Por fim, quanto ao princípio da precaução dentre muitos outros documentos, aparece no Princípio 15 da Declaração do Rio:

“Com o fim de proteger o meio ambiente, o princípio da precaução deverá ser amplamente observado pelos Estados, de acordo com suas capacidades. Quando houver ameaça de danos graves ou irreversíveis, a ausência de certeza científica absoluta não será utilizada como razão para o adiamento de medidas economicamente viáveis para prevenir a degradação ambiental.”

Assim, o princípio da precaução, ao contrário do princípio da prevenção, aplica-se a situações em que há incerteza sobre a ocorrência de um dano grave ao meio ambiente (D’ORNELLAS e WALDMAN, 2018: 656). O princípio da precaução surge no contexto da sociedade do risco, causada pelo desenvolvimento tecnológico. Este cria situações em que graves riscos podem vir a se concretizar sem que se possa prever exatamente quando e como. (D’ORNELLAS e WALDMAN, 2018: 656).

O meio ambiente digital também traz riscos graves, apesar de incertos, por exemplo quanto aos efeitos das redes sociais na democracia. Sabe-se que riscos existem (RODOTÀ, 2004; WALDMAN e NOGUEIRA, 2023: 2247–2266), mas não se pode determinar com certeza quais as suas consequências. De fato, as democracias vão desaparecer, se não houver regulação? Devemos ter mais regulação das redes? Quais as consequências para democracia? Quais as consequências para a economia?

Outro risco no âmbito do meio ambiente digital é o uso da IA, cada vez mais comum, trazendo uma série de desafios éticos e jurídicos (SICHMAN, 2021: 27-49), em especial pensado nos seus efeitos para direitos fundamentais, por exemplo no processo civil (REICHELT, 2021:387-408).

É necessário, portanto, fazer uma análise aprofundada do tema de modo extrair todas as consequências do caráter ambiental do ciberespaço, ou meio ambiente digital

IV. O princípio da precaução

No que diz respeito ao princípio da precaução, este é tradicionalmente encontrado no Direito Ambiental, possuindo conotação bem precisa expressa no já mencionado Princípio 15 da Declaração do Rio (ONU, 1992). Também surge na Convenção da Diversidade Biológica (ONU, 1992) e da mesma forma, encontra lugar na Convenção-Quadro das Nações Unidas acerca da Mudança do Clima, no art. 3º, princípio 3 (ONU, 1992).

É, ainda, “orientador do processo de decisão política nas áreas do ambiente e da defesa dos consumidores” nos Tratados de Maastricht e Amsterdam da União Europeia.

O princípio da precaução tem incidência no meio ambiente digital por exemplo no art. 5º, XVII da LGPD: “XVII - relatório de impacto à proteção de dados pessoais: documentação do controlador que contém a descrição dos processos de tratamento de dados pessoais que podem gerar riscos às liberdades civis e aos direitos fundamentais, bem como medidas, salvaguardas e mecanismos de mitigação de risco”.

Entretanto, esse documento e outros semelhantes relacionados com a IA, por exemplos, deveriam ser apresentados pelo empreendedor antes iniciar sua atividade, em especial quando atingem grande número de pessoas e/ou afetam de maneira importante direitos fundamentais. Isso tendo em vista o art. 225 §1º, IV da CF:

“Art. 225. (...)

IV - exigir, na forma da lei, para instalação de obra ou atividade potencialmente causadora de significativa degradação do meio ambiente, estudo prévio de impacto ambiental, a que se dará publicidade;”.

Para Canotilho e Leite (2012), o princípio da precaução atua de forma in dubio pro ambiente, ou seja, havendo dúvidas, a decisão será a favor do meio ambiente. O que significa que a responsabilidade pelos riscos que exsurgem dos resultados científicos obtidos, é atribuída a que interessa o seu desenvolvimento. Essa responsabilização surge pelo fato de se ignorar os efeitos danosos da atividade.

Já Silva (2004: 75-92) apregoa que o princípio da precaução impõe uma mudança de conduta, ante aos riscos e incertezas científicas que podem surgir.

Nodari e Guerra (2003: 105-116) preconizam a relação de respeito do homem com a natureza, tratando a precaução como um conjunto de medidas antecedentes que visem a proteção da saúde das pessoas e ecossistemas existentes. Nesse sentido, a precaução seria o princípio que norteia as atividades do homem, e no qual estão inseridos os conceitos de justiça, equidade, respeito, senso comum e prevenção.

De qualquer forma, é consenso que dentre os conceitos existentes sobre o princípio da precaução, tem se destacado quanto a incerteza do dano ambiental. Nesse diapasão, para Machado, o princípio tem aplicação enquanto paira a incerteza, a dúvida quanto ao impacto a ser causado pelo dano.

Silva (2004: 75-92) adverte que implicará em infração ao disposto constitucionalmente, o desrespeito ao princípio da precaução, ou seja, “o não afastamento do perigo que um conjunto de atividades possa vir a causar, para as gerações presentes quanto para as gerações futuras, comprometendo o direito de todos ao meio ambiente ecologicamente equilibrado”.

O princípio da prevenção, ao contrário do princípio da precaução, considera que há conhecimento científico sobre as consequências de uma atividade. Para Milaré (2015, p. 264) o primeiro visa evitar danos ambientais por meio da exigência de que o responsável por empreendimentos e atividades efetiva ou potencialmente poluidoras tome determinadas medidas capazes de impedir tais danos.., Já a precaução remete a uma decisão em condição de incerteza, quando os possíveis danos são inaceitáveis considerando o padrão de proteção adotado pelo Estado.

Assim, o princípio da prevenção exige a tomada de medidas que evitem danos ambientais que, se sabe, irão acontecer se tais medidas não forem tomadas. Tal princípio, portanto, aplica-se para situações em que a ciência vigente consegue estabelecer relações de causa e efeito (CARVALHO, 2013, loc.1397). Exemplo de aplicação no âmbito do meio ambiente digital é o vazamento de dados pessoais, gerando uma série de danos para seus titulares (RUARO, 2015, p. 32).

A precaução diz respeito, como dito, a situações nas quais os possíveis danos são grave, mas a análise científica não permite uma verificação segura da relação de causalidade (CARVALHO, 2013, loc.1397).

Essa distinção tem relevância no caso das TIC, especialmente em cenário no qual elas têm avançado cada vez mais, uma vez que seus impactos ainda não são conhecidos, o que impende a necessidade de revisão dos padrões utilizados e das condutas adotadas, de forma a minimizar a predisposição a exposição aos riscos.

Nesse sentido, Defur e Kaszuba (2002: 155-165) apregoam que o princípio da precaução compreende quatro pontos: uma ameaça de danos, a ausência de certeza científica, relações de causa e efeito ainda não comprovadas e a necessidade ou dever de agir ante a falta de segurança, de modo que os responsáveis devem proteger o meio ambiente ou a saúde humana.

Milaré e Setzer (2006), em estudo sobre a exposição a campos eletromagnéticos gerados por estações de radiocomunicação, atentam para o fato de que a comunidade científica e representantes da sociedade civil têm utilizado o princípio da precaução a fim de questionar e impor restrições para a instalação de antenas transmissoras de radiocomunicação, dada a incerteza cientifica das consequências advindas da atividade para a saúde humana.

É importante entender, no contexto de tantas incertezas, é a tomada de decisão precisa ser, o mais possível democratizada. Nesse contexto, a precaução pode ser vista com um processo, no qual uma série de atos precisam ser praticados, permitindo inclusive a participação popular, para a tomada de decisão em matéria onde há a incerteza sobre riscos de danos graves (D’ORNELLAS e WALDMAN, 2018:653-681). O processo de decisão deve ser organizado de modo a atribuir ao público decisões que lhe são pertinentes, decisões sobre ações que estejam de acordo com a constituição, não sobre a verificação de fatos, que deve caber à ciência. Nesse sentido, pode ser utilizado o seguinte procedimento:

“Antecedentes: análise de risco, considerando dúvida relevante, existência de evidências científicas, gravidade do dano, probabilidade do mesmo e ainda a existência de processos de consulta pública. É relevante dizer que, no limite, todos os elementos da análise podem ser expostos ao escrutínio público a partir de dados fornecidos pelos experts. A necessidade de justificar e convencer os cidadãos pode contribuir, e muito, para que as decisões técnicas sejam racionais e menos sujeitas às distorções decorrentes de pontos de vista parciais.

Decisão: deve ser tomada pelo órgão competente, motivada e provisória.

Acompanhamento: novas análises de risco com base em novos conhecimentos, se existentes, e continuidade das consultas à população.”

Em se tratando de IA, essas fases são completamente aplicáveis. Considerando o impacto que pode gerar aos direitos fundamentais, o uso da IA, o mesmo deve sofrer uma avalição prévia e, sempre, provisória do poder público. Importante lembrar que o aprendizado automático de máquina (machine learning) por meio do qual o algoritmo encontra padrões sozinho, para além das instruções que recebe do programador (O’NEIL, 2020: 86) e são processos que não são completamente conhecidos pelos próprios desenvolvedores.

Sem entrar na discussão das especificidades da regulação, a política da União Europeia (2024) adota exatamente este critério approach: os chamados sistemas de IA de alto risco devem passar por um “procedimento de verificação de conformidade, antes de serem vendidos ou usados na União Europeia”.

Como o presente estudo demonstra, o princípio analisado tem grande impacto na aferição dos danos causados pela IA. O capítulo a seguir traz caso emblemático a respeito, envolvendo a empresa Neuralink.

V. O caso da Neuralink

A Neuralink é uma empresa fundada por Elon Musk em 2016, que se dedica ao desenvolvimento de tecnologia de interface neuronal, através da implantação de microchips no cérebro humano, capaz de registrar e estimular a atividade cerebral (NEURALINK, 2024).

Em janeiro de 2024 Musk divulgou publicamente que o primeiro ensaio clínico com um paciente humano havia sido um sucesso. A experiência demonstrou que é possível controlar o mouse de um computador utilizando apenas os comandos cerebrais humanos (HAMILTON e NOLAN, 2024).

A empresa afirma que há benefícios capazes de auxiliar a medicina para que sejam beneficiadas as pessoas com doenças neurodegenerativas, restaurando conexões neuronais perdidas, como o Alzheimer, através do monitoramento das habilidades cognitivas dos indivíduos, e prevenção de crises epilépticas (PISARCHIK, MAKSIMENKO e HRAMOV, 2019).

A Neuralink também ambiciona implementar uma IA capaz de competir com o cérebro humano, através do acompanhamento das funções cerebrais (KULSHRESHTH, ANAND e LAKANPAL, 2019: 105-109). O desafio seria ter uma interface entre o cérebro humano e a máquina, a fim de restaurar a capacidade motora das pessoas como distúrbios neuronais (MUSK, 2019).

Segundo divulgado pela empresa, a experiência com o indivíduo humano consiste em um microchip de tamanho similar ao de uma moeda, implantado cirurgicamente no crânio do paciente, por um robô projetado para essa atividade pela Neuralink. Cada fio de eletrodo tem a espessura 20 vezes mais fina que o fio de um cabelo humano, e são equipados com cerca de 1024 eletrodos capazes de acompanhar a atividade cerebral, estimulando-a através da transmissão de dados sem fio, permitindo aos pesquisadores analisar em tempo real a atividade de cada neurônio, de forma precisa.

Essa quantidade de eletrodos possibilita o aumento na precisão, classificação e interpretação da atividade elétrica cerebral, e maior transferência do volume de dados neuronais, permitindo que sejam enviados a uma máquina para sua análise, e que estímulos sejam também enviados ao cérebro, auxiliando assim no tratamento de distúrbios neuronais (KULSHRESHTH, ANAND e LAKANPAL, 2019: 105-109).

De acordo com o estudo efetuado, os dados neuronais se apresentam como padrões de picos, podendo ser convertidos por algoritmos e mantidos em armazenamento externo em dispositivo da empresa, sendo possivel a análise até mesmo através de aplicativo da Neuralink para iPhone (FIANI, REARDON, AYRES, CLINE e SITTO, 2021: e14192).

Estes dados, entretanto, com o desenvolvimento da tecnologia, podem ser utilizados de forma inadequada. Uma possiblidade é, subreptíciamente, influenciar as decisões do paciente – quais decisões serão realmente do paciente e quais são tomadas pela IA? Além disso, os benefícios podem ser distribuidos de forma desigual, reforçando o abismo entre pobres e riscos. O acesso aos pensamentos e memórias do paciente também pode ser ampliado, colocando em questão a privacidade dos indivíduos (WAISBERG, ONG e LEE, 2024).

Além destes problemas mais específicos do meio ambiente digital, existem os problemas tradicionais das pesquisas com seres vivos.

Em 2020 foi exibido pela Neuralink uma porca chamada Gertrude, com um microchip implantado em seu crânio, permitindo registrar sua atividade neuronal na busca por alimentos. Com relação a esse episódio, especialistas concordam que se trata de tecnologia inovadora, enquanto parte da sociedade científica considera os riscos dos danos que a atividade pode causar ao bem-estar dos animais testados, considerando que a maioria das interfaces neurais utilizadas nas experiências, envolvem fios saindo da pele (HAMILTON e NOLAN, 2024).

Outra experiência divulgada pela empresa envolvia um macaco chamado Pager, jogando vídeo game, apenas com os impulsos cerebrais. O animal jogava em troca de recompensas, controlando o cursor através do uso de sinais cerebrais.

Em fevereiro de 2022 um grupo de defesa da causa animal chamado Comitê de Médicos pela Medicina Responsável, denunciou a Neuralink em razão dos maus tratos aos macacos utilizados nos experimentos científicos, após terem acesso a mais de 700 páginas de documentos sobre os animais utilizados em experimentos científicos da empresa, incluindo prontuários veterinários e laudos de necropsia. A documentação indicou sofrimento extremo dos animais como resultado de cuidados inadequados e implantes cranianos experimentais altamente invasivos (HAMILTON e NOLAN, 2024).

Em que pesem todas as polêmicas envolvendo animais, os estudiosos entendem que ainda há dúvidas quanto ao potencial da Neuralink na prática em cirurgias neurológicas, dos benefícios que podem ser levados aos pacientes (FIANI, REARDON, AYRES, CLINE e SITTO, 2021: e14192).

Percebe-se, portanto, a necessidade da aplicação do princípio da precaução. Por se tratar de tratamento de dados pessoais por tecnologias da informação e comunicação, a IA é um elemento do meio ambiente digital, sujeitando-se aos princípios do direito ambiental. Dentre tais princípios, destaca-se o da precaução por se tratar de um caso em que existe o risco de danos gravíssimos sem que se possa afirmar com certeza científica de que eles se concretizarão.

Isso exige um procedimento específico para além das autorizações da área da saúde em que questões sobre tratamento de dados, segurança de dados, autonomia e equidade na distribuição de ônus e bônus da aplicação da IA. Elementos deste procedimento devem ser a participação popular, a transparência e a temporariedade das decisões.

Considerações finais

O crescente avanço de novas tecnologias da informação e de IA tem-se apresentado como um dos principais instrumentos de emancipação de pessoas com deficiência, propiciando-lhes o desenvolvimento de potencialidades e a sua inclusão social. Mas, é certo que deve haver uma cautela, tendo em vista a necessidade de prevalência dos direitos fundamentais, e à dignidade da pessoa humana.

Há ainda que se perceber que este avanço, no Brasil, incide no âmbito da proteção do meio ambiente, já que a IA é elemento do meio ambiente digital, o qual, por sua vez, é elemento do meio ambiente cultural nos termos do art. 216, II da CF. O meio ambiente é uno, sendo que as regras e princípios do art. 225, da Constituição também se aplicam ao meio ambiente cultural. Nesse sentido, que se preconizar a importância do princípio da precaução, considerando que há várias implicações éticas que envolvem o tema debatido, além de serem ainda desconhecidos os potenciais danos a serem causados pela interface IA e cérebro humano.

É irrefutável a conciliação necessária da evolução neurotecnológica trazida à baila, com os princípios da precaução e da proteção da autodeterminação do indivíduo. Se de um lado há uma série de benefícios, inclusive tendentes à inclusão das pessoas, por outro lado há perigos, dentre os quais, o livre acesso a dados neuronais e dados pessoais do indivíduo, que podem trazer impactos ainda desconhecidos.

Procedimentos específicos, com base no princípio da precaução, para além dos referentes à saúde, devem ser desenvolvidos, considerando, inclusive, a participação popular.

Referências

• AIAAIC. Algorithmic and Automation Incidents and Controversies. Disponível em https://www.aiaaic.org/, acesso em 02 de abril de 2024.

• Alexy, R. Direitos Fundamentais no Estado Constitucional Democrático: para a relação entre direitos do homem, direitos fundamentais, democracia e jurisdição constitucional. Revista de Direito Administrativo (RDA), 217: 55-66.

• Barcarollo, F. (2021). Inteligência Artificial: Aspectos Ético-Jurídicos. Lisboa: Grupo Almedina.

• Bariffi, F. (2024) Artificial Intelligence, Human Rights and Disability. Disponível em file:///Users/joyceanebezerdemenezes/Downloads/12704-texto%20do%20Artigo-49299-48685-10-20210804%20(2).pdf.

• Belandi, C. (2023). 161,6 milhões de pessoas com 10 anos ou mais de idade utiizaram a internet no país, em 2022. Agência IBGE Notícias. PNAD Contínua. 09 nov. 2023. Disponível em: https://agenciadenoticias.ibge.gov.br/agencia-noticias/2012-agencia-de-noticias/noticias/38307-161-6-milhoes-de-pessoas-com-10-anos-ou-mais-de-idade-utilizaram-a-internet-no-pais-em-2022.

• Belloni, M. L. (2024). Educação a Distância mais aprendizagem aberta. Disponível em http://www. portalsaofrancisco.com.br/alfa/artigos/educacao-a-distancia-mais-aprendizagem.php.

• Benjamin, A. H. V. (1993). Função ambiental. Dano ambiental. Disponível em: https://core.ac.uk/download/pdf/79061973.pdf.

• Carvalho, D. W. de. (2013). Dano ambiental futuro: a responsabilização civil pelo risco ambiental. 2ªed. rev., atual e amp. Porto Alegre: Livraria do Advogado Editora.

• Castells, M. (2000). La era da información: economia, sociedad y cultura. Vol. I La sociedad red. Segunda edición. Madrid:Alianza Editorial.

• Castells, M. (2003). A galáxia da internet: reflexões sobre a internet, os negócios e a sociedade. Tradução de Maria Luiza X. de A. Borges; revisão Paulo Vaz. Rio de Janeiro: Zahar.

• Castells, M. (2010). The rise of the network society: information age v.1. 2nd ed. with new pref. West Sussex: Willey,Blackwell.

• CENTRO REGIONAL DE ESTUDOS PARA O DESENVOLVIMENO DA SOCIEDADE DA INFORMAÇÃO (2023). TIC domicílios 2023: coletiva de imprensa. 16 de novembro de 2023, @NIC.br, São Paulo:@NICbr. Disponível: https://cetic.br/media/analises/tic_domicilios_2023_coletiva_imprensa.pdf.

• D’ornellas, M. C. G. Da S.; Waldman, R. L. (2018). Precaução como processo na Organização Mundial do Comércio: análise da compatibilidade da legislação europeia sobre organismos geneticamente modificados. Novos Estudos Jurídicos, Itajaí (SC), v. 23, n. 2: 653–681, 2018. Disponível em: https://doi.org/10.14210/nej.v23n2.p653-681.

• Convenção sobre Diversidade Biológica. (1992) Disponível: https://www.gov.br/mma/pt-br/assuntos/biodiversidade-e-ecossistemas/convencao-sobre-diversidade-biologica

Convenção-Quadro das Nações Unidas sobre Mudança do Clima. (1992). https://www.planalto.gov.br/ccivil_03/decreto/d2652.htm.

• Canotilho, J. J. G.; leite, J. R. M. (Org.) (2012) Direito Constitucional Ambiental Brasileiro. 5.ed. Rio de Janeiro: Saraiva.

• Defur, P. L., Kaszuba, M. (2002). Implementing the precautionary principle. Science of the Total Environment 288 (1-2), 155-165.

• Fiani, B. et al. (2021) An examination of prospective uses and future directions of Neuralink: the brain-machine interface. Cureus; 13 (3): e14192. Disponível em https://www.cureus.com/articles/55684-an-examination-of-prospective-uses-and-future-directions-of-neuralink-the-brain-machine-interface.pdf.

• Fiorillo, C. A. P. (2015). Princípios constitucionais do direito da sociedade da informação: a tutela do meio ambiente digital. São Paulo: Saraiva.

• Fundo das Nações Unidas para a Infância (2024), disponível em https://news.un.org/pt/story/2021/11/1769892.

• Future of Life. (2024) Pause Giant AI Experimentis: an open letter. Disponível em https://futureoflife.org/open-letter/pause-giant-ai-experiments/.

• Habermas, J.(2012). Sobre a Constituição da Europa: Um Ensaio. Tradução Denilson Luis Werle, Luiz Repa e Rúrion Melo. São Paulo: Editora UNESP.

• Hamilton, I. & Nolan, B. (2024) Neuralink’s first human patient has been revealed. Here’s how we got here. In Business Insider – AI. Disponível em https://www.businessinsider.com/neuralink-elon-musk-microchips-brains-ai-2021-2#neuralink-went-a-step-further-with-its-animal-demos-in-april-2021-when-it-showed-off-a-monkey-playing-video-games-with-its-mind-6.

• Harari, Y. N. (2016) Homo Deus: Uma breve história do amanhã. São Paulo: Companhia das Letras.

• Kemp, S. (2024). Digital 2024: Global Overview Report. 31 jan. 2024. Singapure: Kempios Ltd. Disponível em: https://datareportal.com/reports/digital-2024-global-overview-report.

• Kulshreshth A. et al. (2019). Neuralink- an Elon Musk start-up achieve symbiosis with artificial intelligence. 2019 International Conference on Computing, Communication, and Intelligent Systems (ICCCIS). 105-109. Disponível em https://ieeexplore.ieee.org/document/8974470.

• Lee, K. F. (2019) Inteligência artificial: como os robôs estão mudando o mundo, a forma como amamos, nos comportamos e vivemos. Tradução Marcelo Barbão. Rio de Janeiro. Globo Livros.

• Lopes, A. M. D. (2001). Os direitos fundamentais como limites ao poder de legislar. Porto Alegre: Sergio Antonio Fabris.

• Melo, J. O. de C. (2024) A neurotecnologia e os direitos da personalidade: uma análise dos avanços e potenciais riscos do uso da interface cérebro-máquina na autodeterminação da pessoa. LOPES, A. M. D. Lópes et al. (Orgs.). Desafios da Interface Neurodireito e Inteligência Artificial (pp. 69-80). Livraria do Advogado: Porto Alegre.

• Milaré, É.(2015) Direito do ambiente. 10. ed. São Paulo: Revista dos Tribunais.

• Milaré, É. &; Setzer, J. (2006) Aplicação do princípio da precaução em áreas de incerteza cientifica: exposição a campos eletromagnéticos gerados por estações de radiobase. Revista de direito ambiental, vol. 41: 7-25.

• Mirra, Á. L. V. (2019) Responsabilidade civil ambiental e a jurisprudência no STJ. Cadernos Jurídicos, ano 20, nº 48: 47-71.

• Musk, E. (2019). An integrated brain-machine interface platform with thousands of channels. Journal of Medical Internet Research. vol. 21, n. 10. Disponível em https://www.jmir.org/2019/10/e16194/.

• Neuralink. Disponível em https://neuralink.com/, acesso em 15 de maio de 2024.

• Neuralink. Journal of Medical Internet Research. vol 21, n. 10. Disponível em https://www.jmir.org/2019/10/e16356/.

• Nodari, R. O.; Guerra, M. P.(2003) Plantas transgênicas e seus produtos: impactos, riscos e segurança alimentar. Revista de Nutrição, v.16, n.1, p.105-116.

• Novelino, M. (2014) Direito Constitucional. 9ª ed. São Paulo: Método.

• O’NEIL, Cathy. Algoritmos de destruição em massa: como big data aumenta a desigualdade e ameaça a democracia. Santo André: Editora Rua do Sabão, 2020.p. 86.

• Organização Mundial da Saúde. (2024). Ética e governança da inteligência artificial para saúde. Disponível em https://www.who.int/publications/i/item/9789240029200.

• Organização Mundial da Saúde. (2024). Ética da Saúde Global. Disponível em https://www.who.int/health-topics/ethics-and-health#tab=tab_1,

• Organizações das Nações Unidas. (2024). Chefe de direitos humanos da ONU pede moratória para inteligência artificial. Disponível em https://brasil.un.org/pt-br/103544-.

• Organização das Nações Unidas. (1992). Declaração sobre o meio ambiente e desenvolvimento. Rio Declaration. United Nations Conference on Environment and Development, Rio de Janeiro, Brasil, 3-14 de junho de 1992. Disponível em https://www.un.org/en/conferences/environment/rio1992.

• Perez Luño, A. E. (2003) Derechos humanos, estado de derecho y constituición. 8. ed. Madrid: Tecnos.

• Pisarchik, A. N. et al. (2019). From novel technology to novel applications: comment on "an integrated brain-machine interface platform with thousands of channels" by Elon Musk and Pompermayer, F.C.L. et al.(2021). Aprimoramento cognitivo: técnicas e controvérsias. ethic@. Revista internacional de filosofia da moral. v. 20, n. 1, 57-87.

• Radabaugh, M. P. (1993). Study on the financing of assistive technology devices of services for individuals with disabilities. . Disponível em https://eric.ed.gov/?id=ED355696.

• Reichelt, L. A. (2021). Inteligência artificial e direitos fundamentais processuais no âmbito cível: uma primeira aproximação. Revista de Processo. vol. 312. ano 46:387-408. Disponível em: https://meriva.pucrs.br/dspace/bitstream/10923/19405/2/Inteligncia_artificial_e_direitos_fundamentais_processuais_no_mbito_cvel_uma_primeira_aproximao.pdf.

• Rodotà, S. (2008). A vida na sociedade da vigilância: a privacidade hoje. Rio de Janeiro: Renovar.

• Ruaro, R. L. (2015). Direito fundamental à liberdade de pesquisa genética e à proteção de dados pessoais: os princípios da prevenção e da precaução como garantia do direito à vida privada. Revista do Direito Público. Londrina, v.11, n.2: 9-38. Disponível em: http://doi.org/10.5433/ 1980-511X.2015v10n2p9.

• Russell, S. (2019). Human compatible: artificial intelligence and the problem of control. New York: Viking.

• Sarlet, I. W. (2021). A Eficácia dos Direitos Fundamentais - Uma Teoria Geral dos Direitos Fundamentais na Perspectiva Constitucional. Porto Alegre: Editora do Advogado.

• Sarlet, I. W.; Fensterseifer, T. (2023). Curso de Direito Ambiental. São Paulo: Grupo GEN. Disponível em: https://app.minhabiblioteca.com.br/#/books/9786559648603/.

• Sichman, J. S. (2021). Inteligência Artificial e sociedade: avanços e riscos. Estud. av. 35: 101: 27-49. Disponível em: https://doi.org/10.1590/s0103-4014.2021.35101.004

• Silva, S. T. (2004) Princípio da precaução: uma nova postura em face dos riscos e incertezas científicas. M.D. VARELLA, M. & A. F. B PLATIAU. (Org.) Princípio da Precaução (p.75-92). Belo Horizonte: Del Rey.

• Siqueira Junior, P. H. (2010). Direitos Humanos e Cidadania. 3ª ed. São Paulo: Revista dos Tribunais.

• Supremo Tribunal Federal (2006). ADI 3540 MC, Relator(a): CELSO DE MELLO, Tribunal Pleno, julgado em 01-09-2005, DJ 03-02-2006. P. 00014.

• Takahashi, T. (2000). Sociedade da informação no Brasil: Livro Verde. Brasília: Ministério da Ciência e Tecnologia.

• Trennepohl, T. (2024). Manual de direito ambiental. São José dos Campus. SRV Editora LTDA.

• União Europeia. (2024) Artificial Inteligence Act. Briefing: EU legislation in progress. Bruxelas: União Europeia Disponível em https://www.iisf.ie/files/UserFiles/cybersecurity-legislation-ireland/EU-AI-Act.pdf.

• Universidade de Stanford. (2023) Artificial intelligence index report 2023. Stanford: • Universidade de Stanford. Disponível em https://aiindex.stanford.edu/wp-content/uploads/2023/04/HAI_AI-Index-Report_2023.pdf

• Vaughan, T. M. (2003) Guest Editorial: Brain-computer interface technology: a review of the second international meeting. IEEE Transactions on Neural Systems and Rehabilitation Engineering, vol. 11, n. 2, june: 94-109. https://doi.org/: 10.1109/TNSRE.2003.814799

• Vigliar, J. M. M. ; Waldman, R. L. ; Lima, F. R. S. (2023). A proteção de dados com direito difuso no direito brasileiro. Revista Justiça do Direito, v. 37:135-170.

• WAISBERG, E., ONG, J. & LEE, A.G.(2024) Ethical Considerations of Neuralink and Brain-Computer Interfaces. Ann Biomed Eng 2024. https://doi.org/10.1007/s10439-024-03511-2.

• Waldman, R. L, & Nogueira, C.R. (2024). Respeitável público, com vocês, a política do espetáculo! Revista Quaestio Iuris, 16(4): 2247–2266. Disponível: https://www.e-publicacoes.uerj.br/quaestioiuris/article/view/72415

• Waltz, E. (2019). Os hackers do cérebro. Nature Biotechnology, 37: 978-987.

• WARSCHAUER, Cecília. As diferentes correntes de autoformação. In Revista Educação online. São Paulo: Editora Segmento, 2005, disponível em https://www.academia.edu/download/95313724/As_diferentes_correntes_de_autoformacao.pdf

• Xerez, R. M. (2017). Contribuições para construção do conceito de direitos fundamentais. N.S. Siqueira e R.M. XEREZ (org.). Desafios à concretização dos Direitos fundamentais na sociedade da informação (p. 199-213). Rio de Janeiro: Lumen Juris.

1 Doutoranda em Direito Político e Econômico pela Universidade Presbiteriana Mackenzie (UPM); Mestre em Direito do Trabalho pela Pontifícia Universidade Católica de São Paulo – PUC/SP; Mestre em Direito da Sociedade da Informação pela FMU; Membro dos Grupos de Pesquisa em Meio Ambiente Digital e Direito Humanos da UPM; Autora de artigos científicos; Advogada; aureamaria.adv@gmail.com; 11 96378-2600; https://orcid.org/0000-0001-7901-8147.

2 Doutor em Direito pela Universidade Federal do Rio Grande do Sul (UFRGS). Mestre em Direito do Estado pela UFRGS. Realizou estudos de Pós-Doutorado na Universidade de Salerno. Professor Doutor da Faculdade de Direito da UPM. O presente artigo é parte da pesquisa realizada no âmbito do Grupo de Pesquisa Meio Ambiente Digital e Direitos Humanos da UPM. Advogado; ricardolibelwaldman@yahoo.com; https://orcid.org/0000-0002-5437-648X